Pokud pro vytváření svých hesel používáte umělou inteligenci, měli byste je co nejdříve změnit. Výzkum kyberbezpečnostní firmy Irregular, který ověřila stanice Sky News, totiž odhalil, že populární modely jako ChatGPT, Claude nebo Gemini generují hesla, která jsou vysoce předvídatelná. Přestože se na první pohled zdají být silná, ve skutečnosti obsahují opakující se vzorce, které mohou kyberzločinci snadno odhalit pomocí automatizovaných nástrojů.

Spoluzakladatel firmy Irregular Dan Lahav varuje, že používání AI k tomuto účelu je nebezpečné. Podle něj lidé často netuší, že jde o problém, a spoléhají na to, že jim umělá inteligence poskytne náhodný řetězec znaků. Realita je však taková, že velké jazykové modely (LLM) nejsou schopny skutečné náhody. Namísto toho vytvářejí výsledky na základě vzorců ve svých tréninkových datech, což vede k vytvoření pouhé iluze bezpečnosti.

Výzkumníci například testovali model Claude od společnosti Anthropic a z padesáti vygenerovaných hesel jich bylo unikátních pouze 23. Jedno konkrétní heslo se v testu zopakovalo dokonce desetkrát. Podobné tendence k opakování stejných řetězců nebo velmi podobných struktur vykazovaly i modely od OpenAI a Googlu. Problém se nevyhnul ani systému NanoBanana, který při požadavku na obrázek hesla napsaného na papírku generoval stále stejné znaky.

Nebezpečí spočívá v tom, že běžné online nástroje pro kontrolu síly hesla tyto výstupy hodnotí jako extrémně bezpečné. Některé z nich odhadovaly, že prolomení hesla od AI by trvalo biliardy let. Tyto kontrolory však nejsou naprogramovány tak, aby vnímaly specifický vzorec, který umělá inteligence používá. Podle Lahava by v důsledku této předvídatelnosti dokázaly tato hesla v relativně krátkém čase prolomit i starší a méně výkonné počítače.

Tento problém se netýká jen běžných uživatelů, ale i vývojářů, kteří AI využívají k psaní kódu. Při vyhledávání na platformě GitHub se ukázalo, že úryvky typických AI hesel se již vyskytují ve stovkách projektů. Mnohdy jde o nevinné příklady v dokumentaci nebo testovacím kódu, ale výzkumníci narazili i na případy, kdy byla tato předvídatelná hesla použita v reálných serverech nebo službách. Uživatelé tak mohou být ohroženi, aniž by o tom vůbec věděli.

Odborníci proto doporučují, aby technologické firmy své modely upravily. Ideálním řešením by bylo, kdyby umělá inteligence při požadavku na heslo automaticky použila externí nástroj pro generování skutečně náhodných znaků, podobně jako člověk používá kalkulačku pro přesné výpočty. Do té doby zůstává odpovědnost na uživatelích, kteří by se při správě svého soukromí měli raději spoléhat na specializované správce hesel nebo biometrické údaje.

Graeme Stewart z firmy Check Point uklidňuje veřejnost tím, že jde o jeden z mála bezpečnostních problémů, který má velmi jednoduché řešení. Situaci řadí do kategorie rizik, která jsou sice závažná, ale lze se jim snadno vyhnout. Není podle něj důvod k panice, že by byl v tuto chvíli napaden úplně každý, ale opatrnost je na místě.

Pokud nemáte možnost využívat modernější metody autentizace, jako je rozpoznávání obličeje nebo otisk prstu (tzv. passkeys), univerzální rada expertů zůstává stejná. Pro maximální bezpečnost si zvolte dlouhou a zapamatovatelnou frázi, kterou si sami vymyslíte. Hlavním pravidlem však zůstává: v této konkrétní věci se nikdy neptejte umělé inteligence.

Spojené státy vyvíjejí silný diplomatický nátlak na palestinské vedení, aby stáhlo svou kandidaturu na funkci místopředsedy Valného shromáždění OSN. Washington se obává, že by tato pozice umožnila Palestincům řídit významné debaty o Blízkém východě, zejména během ostře sledovaného týdne summitů na vysoké úrovni v New Yorku. Podle interního dokumentu ministerstva zahraničí dostalo americké velvyslanectví v Jeruzalémě pokyn předat Palestinské autonomii oficiální protest. Diplomatická depeše výslovně varuje, že pokud palestinská strana kandidaturu do stanoveného termínu nestáhne, budou následovat blíže nespecifikované důsledky.

Námořnictvo íránských Revolučních gard oznámilo, že během uplynulých 24 hodin umožnilo proplout více než 25 plavidlům včetně ropných tankerů skrze strategický Hormuzský průliv. Podle oficiálních údajů Teheránu trasou úspěšně prošlo celkem 26 lodí. Tato zpráva přichází v době, kdy Írán otevřeně varoval, že pokud Spojené státy a Izrael obnoví své útoky na islámskou republiku, stávající konflikt se rozšíří i daleko mimo oblast Blízkého východu.

Během snahy svrhnout současné vedení v Íránu se objevila nová tvrzení, podle kterých měly Spojené státy a Izrael v úmyslu dosadit do čela země populistu Mahmúda Ahmadínežáda. Bývalý íránský prezident, jenž vládl v letech 2005 až 2013, byl v minulosti známý svými ostrými výpady vůči Izraeli. Později se však dostal do konfliktů s nejvyšším vůdcem Alím Chameneím, načež změnil svou rétoriku, začal režim kritizovat a prezentoval se jako ochránce chudých.

Letní prázdniny jsou už za rohem, přesto zprávy kolem letecké dopravy nepůsobí pro turisty zrovna uklidňujícím dojmem. Dovolenkáři po celé Evropě se letos musí přizpůsobovat dražší ropě, rostoucím cenám leteckého paliva i nejistotě spojené s konfliktem na Blízkém východě.

Léto v Česku sice ještě nezačalo, ale na počasí typické pro nejteplejší část roku už došlo. A podle předpovědi ho přinese i probíhající týden. Víkend totiž nabídne maxima vyšší než 25 stupňů, vyplývá z informací Českého hydrometeorologického ústavu (ČHMÚ).

Organizace pro výživu a zemědělství ve středu varovala, že uzavření Hormuzského průlivu by mohlo během šesti až dvanácti měsíců vyvolat vážnou celosvětovou krizi cen potravin, pokud vlády nezačnou rychle jednat.

Světová zdravotnická organizace ve středu potvrdila, že bilance nynější epidemie eboly ve střední Africe dosáhla šesti set podezřelých případů a sto třiceti devíti úmrtí. Šéf organizace Tedros Adhanom Ghebreyesus na tiskové konferenci v Ženevě varoval, že kvůli dlouhému časovému úseku, který uplynul do samotného odhalení viru, budou tato čísla i nadále stoupat. Laboratoře dosud potvrdily padesát jedna případů v Demokratické republice Kongo a dva v sousední Ugandě. Podle odhadů odborníků nákaza v regionu skrytě kolovala pravděpodobně již před několika měsíci, než byla poprvé oficiálně zaznamenána.

Evropští lídři ve středu ráno neskrývali triumfální náladu poté, co Evropská unie dospěla k dohodě o zavedení dlouho odkládané obchodní smlouvy se Spojenými státy. Tento krok přichází po měsících celních hrozeb a transatlantického napětí.

Podle vyjádření amerického prezidenta Donalda Trumpa chyběla v pondělí pouhá hodina k vydání rozkazu k zahájení nové vlny leteckých úderů na Írán. Šéf Bílého domu však na poslední chvíli prostřednictvím sociálních sítí oznámil, že poskytne více času diplomatickému vyjednávání. O den později Trump potvrdil, že americká flotila válečných lodí v regionu je plně připravena k okamžité akci. Skutečný rozsah bezprostředního nebezpečí obnovení bojů však zůstává nejasný, neboť představitelé některých států v Perském zálivu uvedli, že o žádné chystané vojenské operaci neměli informace.

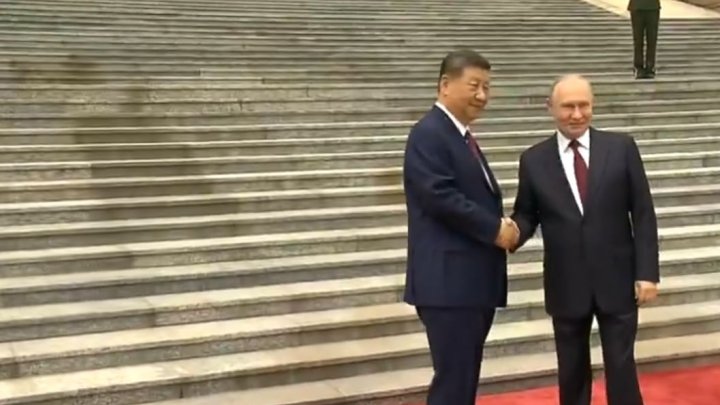

Ruský prezident Vladimir Putin během své středeční státní návštěvy v Pekingu prohlásil, že vztahy mezi Ruskem a Čínou dosáhly bezprecedentně vysoké úrovně. Při jednání se svým protějškem Si Ťin-pchingem se zaměřil především na rozvoj širší hospodářské spolupráce a řešení aktuálních mezinárodních otázek. Ruský vůdce oslovil čínského prezidenta jako drahého přítele a poukázal na dlouhodobou kontinuitu jejich obchodních vztahů, přičemž zmínil, že vzájemný obchodní obrat se za posledních pětadvacet let zvýšil více než třicetkrát.

Ruský prezident Vladimir Putin a čínský vůdce Si Ťin-pching během svého nynějšího vrcholného setkání v Pekingu obnovili plány na výstavbu plynovodu Síla Sibiře 2. Ačkoliv obě strany dospěly k obecnému porozumění ohledně tohoto strategického projektu, podrobnosti o samotné stavbě nebo konkrétní časový harmonogram jejího dokončení nebyly zveřejněny. Tento ambiciózní energetický projekt, který má přepravovat až padesát miliard metrů krychlových zemního plynu ročně, byl v uplynulých letech opakovaně zablokován, zejména kvůli vleklým neshodám obou zemí ohledně výsledné ceny suroviny.

Britský premiér Keir Starmer čelí ostré kritice poté, co Spojené království v tichosti zmírnilo přísné sankce na ruskou ropu. Londýn dříve deklaroval, že zcela zablokuje dovoz ruské ropy zpracované ve třetích zemích, což mělo za cíl co nejvíce omezit finanční toky směřující do Kremlu. V důsledku eskalující války v Íránu a s ní spojeného prudkého růstu cen paliv však britská vláda změnila postoj. Nově tak umožní import leteckého paliva a nafty, které byly z ruské ropy rafinovány v jiných státech.